瑞立视正式对外发布VR多人同时全身动捕软件,开启深度人机交互时代

作为下一代计算平台,虚拟现实(VR)产业不但有提供平台和资源的巨头争相加入VR市场阵营,而且深耕行业应用的优质企业也渐露峥嵘,多人同场景内...

作为下一代计算平台,虚拟现实(VR)产业不但有提供平台和资源的巨头争相加入VR市场阵营,而且深耕行业应用的优质企业也渐露峥嵘,多人同场景内互动已经逐渐成为VR解决方案的一种标配,越来越多针对各自垂直行业的VR成功案例便是VR行业良好发展态势的有力佐证。然而,目前国内大多数多人互动大空间VR方案往往只能追踪到玩家双手和头部的信息,在互相共处的虚拟空间里,玩家之间只能看到对方准确的头和手的位置,却没有完整的身体姿态同步。在某些行业应用的需求里,这大大降低了VR的沉浸感和互动真实度,限制了用户体验,也限制了行业发展。据悉,为顺应VR行业应用发展趋势,解决捕捉局限,全面升级核心技术,革新VR行业发展,引领虚拟现实“行业应用”进入更深度更逼真的人机交互时代,国内领先动作捕捉企业深圳市瑞立视多媒体科技有限公司,已正式宣布,即将推出用于多人全身动作捕捉的软件Tenoomi和Rovonga两位“新成员”:

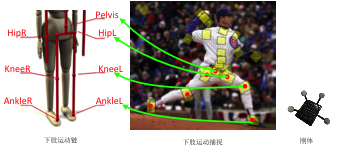

RTS-Tenoomi 全身动捕展示图

即将迎来的全身动捕“新成员”——

RTS-Tenoomi是瑞立视(Realis)推出的一款基于刚体的全身运动捕捉软件,适用于VR虚拟现实,虚拟主播,虚拟拍摄等需要实时(Real-time)进行人机交互的场合。于2018年5月已正式发布并可投入商用。软件最大的特色是除了全身动作捕捉等基本功能之外,其SDK将直接与各大VR引擎(虚幻4,Unity等)进行无缝对接。体验者的身体动作会直接表现在VR引擎内,与场景内的模型和交互逻辑进行零时延的精准互动。

Tenoomi工作时,要求在表演者的头部、双手、双脚以及背部布置刚体,接收瑞立视(Realis)的跟踪定位软件RTS-Tracker传来的表演者身上的刚体数据(刚体的位置及朝向信息),获取表演者的肢端位置,然后结合IK技术以及HSM模型进行全身骨骼解算,估算出表演者的全身动作骨骼姿态。

据悉, Tenoomi具有以下特点:

高效自然的数据解算

RTS-Tenoomi可一键获取来自RTS-Tracker的高精度刚体数据,每个人只需6个刚体数据,便可进行全身骨骼解算,数据处理量少,从而能实现低延时的多人精准的实时交互。要知道,传统的动作捕捉常见的一种手法是表演者需换上贴身的紧身衣,在紧身衣上贴满数十个反光点,或是穿上浑身节点和线缆的惯性式穿戴设备。其目的是做到高流畅度的动作结算。然而,考虑到VR应用必须满足的高效型和穿戴性,VR的体验者们不可能每次体验前都进行繁琐的穿戴或紧身衣服的更换。因此,Tenoomi在设计了进行骨骼解算与重定向时,对用户体型和重定向的人物模型无要求,即只需6个刚体数据,无论用户胖瘦、高矮皆可解算出自然流畅的全身骨骼姿态,并将骨骼重定向到不同比例、不同骨骼的虚拟人物模型上,具有很强的实用性。

支持在线多人实时交互

目前国外可见的全身动捕软件中,虽然能实现全身流畅的动捕,但大部分以支持在线录制影视,体育科研等动作和线下动作编辑为主,较少有在线多人全身动捕的实时交互应用。因为现有的全身动捕过程中,交互的数据处理量庞大,一旦进行多人同时实时捕捉,容易在VR里产生严重的延迟,这是体验者无法接受的。多人在线实时全身互动过程中,有如下问题:单人的全身动捕很容易做到,但是同一个场景多人的全身动捕就很困难,因为每多一个人,全身动捕的刚体数量就直线上升,如何进行数据处理,如何规避和估算遮挡,如何进行骨骼解算才能保证实时性和高精准度同时交互;

为解决上述问题,瑞立视推出的RTS-Tenoomi在数据处理方面做了大量的优化,首先是体验者的穿戴刚体数减少到了6个,这减少了源数据量。但为保证全身骨骼估算效果,Tenoomi应用了具有瑞立视自主知识产权的骨骼姿态算法进行骨骼解算,该算法能够成功优化遮挡问题,并且在源数据量较少的情况下也能进行精确、流畅、自然的全身骨骼估算,从而能够保证多人同时在线实时的全身互动,这在业界內非常少见的。

良好的用户体验

Tenoomi具有友好的UI交互接口,能够给用户良好的交互体验。用户在体验时,无需穿上特制的衣服,只需戴上简单手套或脚套,穿戴方便,便于体验。并且,在体验者体型相差不大的情况下,即使用户发生变化,Tenoomi在不更换解算器的情况下也能精确进行全身解算,这样可以简化用户操作流程,提升用户体验。

Unreal Engine、Unity引擎无缝对接

Tenoomi同时捆绑其专用的UE4/Unity SDK进行发布。不管开发者用的是哪个引擎,哪个版本,Tenoomi都能进行无缝对接与支持。想要在VR里实现全身动作捕捉的开发者们不用再去编辑自己的IK蓝图或C++代码,Tenoomi的SDK为开发者们处理好了在VR里的一切姿态动作表现。并且SDK是以免费的形式提供给开发者团队。只要开启软件,多个虚拟角色就可以在VR里进行自然真实的全身动作交互。

广泛的行业应用

基于动捕技术的Tenoomi骨骼评估可广泛应用于各行各业的VR场景中,如VR大空间游戏场馆、军事训练、职业培训,康复训练等。通过多人同场景的姿势同步,在VR里可以做到更真实的动作训练,逃生路线,仿真培训,姿态分析等,成为更深度更自然的虚拟环境人机交互手段。

再来说说瑞立视准备推出的另一个全身动捕“新成员”RTS-Rovonga。Rovonga是瑞立视推出的一款基于全身布点式的运动捕捉软件,能实现高精度,数据干净,丢失率低的多人全身运动数据捕捉,主要用于影视级别的高流畅性动画制作行业,科研,人体分析,体育运动等行业。预计将在8月份的Siggraph加拿大展上首次面市。据瑞立视相关人员透露,这两款全身动捕软件将相辅相成,配合不同的行业应用场景发挥其不同的作用。

RTS-Rovonga全身动捕展示图

目标是更深度的人机交互产品形态

伴随娱乐消费市场需求的崛起,虚拟现实的行业应用需求也在释放巨大潜力,越来越多垂直行业的需求,专业度要求越来越高的项目需要有技术背景的团队来支撑。

据悉,瑞立视CEO许秋子表示:“瑞立视一直致力于光学动作捕捉和人机交互多媒体技术,而目前正式可以对外推出的全身动捕系统,也是致力于为更多用户提供一个性价比较高,完全国产自主研发,专业技术支持力度高的动作捕捉解决方案。在虚拟世界中,虚拟化身的全身动作捕捉质量意味着我们已经实现了超真实的虚拟人类,他们将在他们的世界中更真实的移动和互动。而在以前,要实现相同水平的真实程度需要花费很多时间和更多成本。瑞立视的全身动作捕捉解决方案对于影视、军事、VR开发者、体育运动,工业仿真领域等的下一时代项目至关重要。”

随着VR的技术发展逐步进化,我们正在向着自己曾经梦想中的完美世界进发。今后的VR体验必定朝着越来越真实,越来越自然融入的人机交互世界的方向前进。动作捕捉技术是未来VR技术中的一项关键性交互技术,已经被国家工信部列为VR五大关键性技术之一。在未来,我们不会仅仅满足于坐在电脑电视前对着屏幕按键鼠标键盘进行操作,我们希望获得是可以在不同世界穿梭、不同时空穿越的全维度沉浸式交互手法。

最后,记得关注微信公众号:镁客网(im2maker),更多干货在等你!

硬科技产业媒体

关注技术驱动创新

微信ID:im2maker

微信ID:im2maker 长按识别二维码关注

长按识别二维码关注